xiaoyaosearch

小遥搜索,听懂你的话、看懂你的图,用AI找到本地任何文件。让搜索像聊天一样简单。XiaoyaoSearch: Understands your words, reads your images, finds any local file with AI. Making search as easy as chatting.

Stars: 738

XiaoyaoSearch is a cross-platform local desktop application designed for knowledge workers, content creators, and developers. It integrates AI models to support various input methods such as voice, text, and image to intelligently search local files. The application is free for non-commercial use, provides source code and development documentation, and ensures privacy by running locally without uploading data to the cloud. It features modern interface design using Electron, Vue 3, and TypeScript.

README:

English Version | 简体中文

小遥搜索是一款专为知识工作者、内容创作者和技术开发者设计的跨平台本地桌面应用(Windows/MacOS/Linux)。通过集成的AI模型,支持语音输入(30秒内)、文本输入、图片输入等多种方式,将用户的查询转换为语义进行智能搜索,实现对本地文件的深度检索。

- 本项目非商业使用完全免费,允许修改和分发(需保留版权声明和协议);商业目的需授权,详细见小遥搜索软件授权协议

- 本项目完全通过Vibe Coding实现,提供所有源码及开发文档(上下文)供大家交流学习

- 🎤 多模态输入:支持语音录音、文本输入、图片上传

- 🔍 深度检索:支持视频(mp4、avi)、音频(mp3、wav)、文档(txt、markdown、office、pdf)的内容和文件名搜索

- 🧠 AI增强:集成BGE-M3、FasterWhisper、CN-CLIP、OLLAMA等先进AI模型

- ⚡ 高性能:基于Faiss向量搜索和Whoosh全文搜索的混合检索架构

- 🔒 隐私安全:本地运行,数据不上传云端,支持隐私模式

- 🎨 现代界面:基于Electron + Vue 3 + TypeScript的现代化桌面应用

前端技术

- 框架: Electron + Vue 3 + TypeScript

- UI库: Ant Design Vue

- 状态管理: Pinia

- 构建工具: Vite

后端技术

- 框架: Python 3.10 + FastAPI + Uvicorn

- AI模型: BGE-M3 + FasterWhisper + CN-CLIP + Ollama

- 搜索引擎: Faiss (向量搜索) + Whoosh (全文搜索)

- 数据库: SQLite + 索引文件

xiaoyaosearch/

├── backend/ # 后端服务 (Python FastAPI)

│ ├── app/ # 应用核心代码

│ │ ├── api/ # API路由层

│ │ ├── core/ # 核心配置

│ │ ├── models/ # 数据模型

│ │ ├── services/ # 业务服务

│ │ ├── schemas/ # 数据模式

│ │ └── utils/ # 工具函数

│ ├── requirements.txt # Python依赖

│ ├── main.py # 应用入口

│ └── .env # 环境变量

├── frontend/ # 前端应用 (Electron + Vue3)

│ ├── src/ # 源代码

│ │ ├── main/ # Electron主进程

│ │ ├── preload/ # 预加载脚本

│ │ └── renderer/ # Vue渲染进程

│ ├── out/ # 构建输出

│ ├── dist-electron/ # 打包输出

│ ├── resources/ # 应用资源

│ ├── package.json # Node.js依赖

│ └── electron-builder.yml # 打包配置

├── docs/ # 项目文档

│ ├── 00-mrd.md # 市场调研

│ ├── 01-prd.md # 产品需求

│ ├── 02-原型.md # 产品原型

│ ├── 03-技术方案.md # 技术方案

│ ├── 04-开发任务清单.md # 开发任务

│ ├── 05-开发排期表.md # 开发排期

│ ├── 开发进度.md # 进度跟踪

│ ├── 接口文档.md # API文档

│ ├── 数据库设计文档.md # 数据库设计

│ └── 高保真原型/ # UI原型

├── data/ # 数据目录

│ ├── database/ # SQLite数据库

│ ├── indexes/ # 搜索索引

│ │ ├── faiss/ # 向量索引

│ │ └── whoosh/ # 全文索引

│ ├── models/ # 模型文件

│ └── logs/ # 日志文件

├── .claude/ # Claude助手配置

├── LICENSE # 软件授权协议(中文版)

├── LICENSE_EN # 软件授权协议(英文版)

├── README.md # 项目说明(中文版)

└── README_EN.md # 项目说明(英文版)

适用人群:非开发者、希望快速体验小遥搜索的用户 支持平台:仅支持 Windows 部署难度:⭐ 简单(一键安装)

从百度网盘下载最新的 Windows 整合包:

请选择最新版本下载(如 XiaoyaoSearch-Windows-v1.1.1.zip)

1. 解压整合包

将下载的压缩包解压到任意目录(建议不要包含中文路径)

2. 运行环境准备脚本

双击运行 scripts/setup.bat,脚本会自动完成以下操作:

- 解压 Python 嵌入式运行时

- 安装后端 Python 依赖

- 安装前端 Node 依赖

- 生成配置文件

- 创建数据目录

3. 安装 Ollama

双击运行 runtime\ollama\OllamaSetup.exe,按提示完成安装。

安装完成后,打开命令行运行:

ollama serve

ollama pull qwen2.5:1.5b4. 下载 AI 模型

从百度网盘下载默认模型:

- 链接:https://pan.baidu.com/s/1jRcTztvjf8aiExUh6oayVg

- 提取码:ycr5

将模型解压到对应目录:

-

data\models\embedding\BAAI\bge-m3\- 嵌入模型 -

data\models\cn-clip\- 视觉模型 -

data\models\faster-whisper\- 语音识别模型

5. 启动应用

双击运行 scripts/startup.bat,脚本会:

- 启动后端服务

- 启动前端服务

详细文档:整合包部署指南

适用人群:开发者、希望参与项目贡献的用户 支持平台:Windows / macOS / Linux 部署难度:⭐⭐⭐ 需要开发环境

- 操作系统: Windows / macOS / Linux

- Python: 3.10.11+(https://www.python.org/downloads/)

- Node.js: 21.x+(https://nodejs.org/en/download)

- 内存: 建议16GB 以上

- 显卡: 建议RTX3060 6GB以上

1. 克隆项目

git clone https://github.com/dtsola/xiaoyaosearch.git

cd xiaoyaosearch2. 后端部署

# 进入后端目录

cd backend

# 安装依赖包(默认CPU版本的推理引擎)

pip install -r requirements.txt

# 安装faster-whisper

pip install faster-whisper

# 启用CUDA(可选,注意:cuda版本需根据环境确定)

pip uninstall torch torchaudio torchvision

pip install torch==2.1.0+cu121 torchaudio==2.1.0+cu121 torchvision==0.16.0+cu121 --index-url https://download.pytorch.org/whl/cu121

安装ffmpeg: https://ffmpeg.org/download.html

安装ollama: https://ollama.com/

配置 .env 文件:

# 数据配置

FAISS_INDEX_PATH=../data/indexes/faiss

WHOOSH_INDEX_PATH=../data/indexes/whoosh

DATABASE_PATH=../data/database/xiaoyao_search.db

# API配置

API_HOST=127.0.0.1

API_PORT=8000

API_RELOAD=true

# 日志配置

LOG_LEVEL=info

LOG_FILE=../data/logs/app.log准备模型: 系统默认模型说明:

- ollama:qwen2.5:1.5b

- 嵌入模型:BAAI/bge-m3

- 语音识别模型:Systran/faster-whisper-base

- 视觉模型:OFA-Sys/chinese-clip-vit-base-patch16

注意:建议先准备默认模型,先成功启动应用后,再更换模型。

ollama模型: ollama pull qwen2.5:1.5b (根据情况自行选择)

所有模型下载地址:(百度盘) 链接: https://pan.baidu.com/s/1jRcTztvjf8aiExUh6oayVg?pwd=ycr5 提取码: ycr5

嵌入模型:

- 模型根目录:data/models/embedding

- 将下载的模型直接解压放入到根目录即可,以下是对应关系

- data/models/embedding/BAAI/bge-m3

- data/models/embedding/BAAI/bge-small-zh

- data/models/embedding/BAAI/bge-large-zh

语音识别模型:

- 模型根目录:data/models/faster-whisper

- 将下载的模型直接解压放入到根目录即可,以下是对应关系

- data/models/faster-whisper/Systran/faster-whisper-base

- data/models/faster-whisper/Systran/faster-whisper-small

- data/models/faster-whisper/Systran/faster-whisper-medium

- data/models/faster-whisper/Systran/faster-whisper-large-v3

视觉模型:

- 模型根目录:data/models/cn-clip

- 将下载的模型直接解压放入到根目录即可,以下是对应关系

- data/models/cn-clip/OFA-Sys/chinese-clip-vit-base-patch16

- data/models/cn-clip/OFA-Sys/chinese-clip-vit-large-patch14

启动后端服务:

# 使用内置配置启动

python main.py

# 或使用uvicorn启动

uvicorn main:app --host 127.0.0.1 --port 8000 --reload# 进入前端目录

cd frontend

# 安装依赖

npm install

# 启动开发服务器

npm run dev感谢你对小遥搜索的关注!我们欢迎任何形式的贡献,无论是代码、文档、Bug 修复还是新功能建议。

步骤 1:Fork 项目

- 访问 xiaoyaosearch 仓库

- 点击右上角的 "Fork" 按钮,将项目 Fork 到你的 GitHub 账户

步骤 2:克隆到本地

git clone https://github.com/<你的用户名>/xiaoyaosearch.git

cd xiaoyaosearch步骤 3:创建功能分支

git checkout -b feature/你的功能名称

# 或

git checkout -b fix/问题描述步骤 4:进行开发

- 按照项目代码规范进行开发

- 确保代码有适当的注释

- 运行测试确保功能正常

步骤 5:提交代码

git add .

git commit -m "feat(scope): 简洁描述你的改动"提交格式规范:

-

feat: 新功能 -

fix: Bug 修复 -

docs: 文档更新 -

style: 代码格式调整 -

refactor: 代码重构 -

perf: 性能优化 -

test: 测试相关 -

chore: 构建/工具链相关

步骤 6:推送到 GitHub

git push origin feature/你的功能名称步骤 7:创建 Pull Request

- 访问你 Fork 的仓库页面

- 点击 "Compare & pull request" 按钮

- 填写 PR 描述:

- 标题:简洁说明改动内容

- 描述:详细说明改动原因、实现方式、测试结果

- 等待维护者审核

如果你发现了 Bug 或有功能建议:

- 访问 Issues 页面

- 点击 "New Issue"

- 选择合适的 Issue 模板

- 详细描述问题或建议

- 组件命名:PascalCase(如

SearchPanel.vue) - 变量/函数:camelCase(如

searchResults) - 常量:UPPER_SNAKE_CASE(如

MAX_FILE_SIZE) - 代码注释:使用中文

- 文件命名:snake_case(如

search_service.py) - 类名:PascalCase(如

SearchService) - 函数/变量:snake_case(如

search_files) - 常量:UPPER_SNAKE_CASE(如

MAX_RESULTS) - 代码注释:使用中文

- ✅ 遵循项目的代码规范

- ✅ 保持代码简洁,避免过度设计

- ✅ 添加适当的错误处理

- ✅ 确保代码有适当的测试

- ✅ 更新相关文档

- 💬 微信:dtsola(请备注 "小遥搜索贡献")

- 📧 邮件:通过官网 https://www.dtsola.com 联系

- 📺 B站:https://space.bilibili.com/736015

- 📝 你的名字将出现在项目贡献者列表中

- 🌟 你的改动将帮助成千上万的用户

- 🤝 加入独立开发者社区,交流学习

- 🎁 优秀贡献者可获得项目周边礼品

让我们一起打造更好的本地搜索体验! 🚀

感谢以下人员为本项目做出的贡献:

- @jidingliu - 提交代码及项目宣传

For Tasks:

Click tags to check more tools for each tasksFor Jobs:

Alternative AI tools for xiaoyaosearch

Similar Open Source Tools

xiaoyaosearch

XiaoyaoSearch is a cross-platform local desktop application designed for knowledge workers, content creators, and developers. It integrates AI models to support various input methods such as voice, text, and image to intelligently search local files. The application is free for non-commercial use, provides source code and development documentation, and ensures privacy by running locally without uploading data to the cloud. It features modern interface design using Electron, Vue 3, and TypeScript.

Spring-Broken-AI-Blog

Spring Broken AI Blog is a modern intelligent blog system built on Next.js 15 + TypeScript + AI, integrating AI assistant and RAG (retrieval-augmented generation) functions. It features modern frontend using Next.js with App Router and Turbopack, full-stack TypeScript support, headless components with shadcn/ui + Radix UI + Tailwind CSS, NextAuth.js v4 + JWT authentication strategy, Prisma ORM with SQLite/PostgreSQL, ESLint + Prettier + Husky for code quality, and responsive design. The AI highlights include AI writing assistant based on Kimi API, vector index system using ChromaDB + Ollama for local vector storage, RAG chat function for intelligent Q&A based on article content, AI completion feature for smart content continuation in the editor, AI recommendations for automatic category and tag suggestions, and real-time display of AI-generated content.

adnify

Adnify is an advanced code editor with ultimate visual experience and deep integration of AI Agent. It goes beyond traditional IDEs, featuring Cyberpunk glass morphism design style and a powerful AI Agent supporting full automation from code generation to file operations.

MahoShojo-Generator

MahoShojo-Generator is a web-based AI structured generation tool that allows players to create personalized and evolving magical girls (or quirky characters) and related roles. It offers exciting cyber battles, storytelling activities, and even a ranking feature. The project also includes AI multi-channel polling, user system, public data card sharing, and sensitive word detection. It supports various functionalities such as character generation, arena system, growth and social interaction, cloud and sharing, and other features like scenario generation, tavern ecosystem linkage, and content safety measures.

MarkMap-OpenAi-ChatGpt

MarkMap-OpenAi-ChatGpt is a Vue.js-based mind map generation tool that allows users to generate mind maps by entering titles or content. The application integrates the markmap-lib and markmap-view libraries, supports visualizing mind maps, and provides functions for zooming and adapting the map to the screen. Users can also export the generated mind map in PNG, SVG, JPEG, and other formats. This project is suitable for quickly organizing ideas, study notes, project planning, etc. By simply entering content, users can get an intuitive mind map that can be continuously expanded, downloaded, and shared.

TrainPPTAgent

TrainPPTAgent is an AI-based intelligent presentation generation tool. Users can input a topic and the system will automatically generate a well-structured and content-rich PPT outline and page-by-page content. The project adopts a front-end and back-end separation architecture: the front-end is responsible for interaction, outline editing, and template selection, while the back-end leverages large language models (LLM) and reinforcement learning (GRPO) to complete content generation and optimization, making the generated PPT more tailored to user goals.

N.E.K.O

Project N.E.K.O. is an open-source, community-driven platform aiming to build a digital life form that desires to understand, connect, and grow with us. It is a networked empathetic acknowledging organism, a digital life form that seeks to establish connections and grow together with users. The project's ultimate goal is to create an AI-native metaverse closely connected to the real world, with phases including a creative workshop on Steam, an independent platform with derived games, and the N.E.K.O. Network for autonomous social interactions among AI entities. The core features include open-source core components, sustainable ecosystem, and memory synchronization across different scenarios for a seamless companion experience.

py-xiaozhi

py-xiaozhi is a Python-based XiaoZhi voice client designed for learning through code and experiencing AI XiaoZhi's voice functions without hardware conditions. The repository is based on the xiaozhi-esp32 port. It supports AI voice interaction, visual multimodal capabilities, IoT device integration, online music playback, voice wake-up, automatic conversation mode, graphical user interface, command-line mode, cross-platform support, volume control, session management, encrypted audio transmission, automatic captcha handling, automatic MAC address retrieval, code modularization, and stability optimization.

AI-CloudOps

AI+CloudOps is a cloud-native operations management platform designed for enterprises. It aims to integrate artificial intelligence technology with cloud-native practices to significantly improve the efficiency and level of operations work. The platform offers features such as AIOps for monitoring data analysis and alerts, multi-dimensional permission management, visual CMDB for resource management, efficient ticketing system, deep integration with Prometheus for real-time monitoring, and unified Kubernetes management for cluster optimization.

PromptHub

PromptHub is a versatile tool for generating prompts and ideas to spark creativity and overcome writer's block. It provides a wide range of customizable prompts and exercises to inspire writers, artists, educators, and anyone looking to enhance their creative thinking. With PromptHub, users can access a diverse collection of prompts across various categories such as writing, drawing, brainstorming, and more. The tool offers a user-friendly interface and allows users to save and share their favorite prompts for future reference. Whether you're a professional writer seeking inspiration or a student looking to boost your creativity, PromptHub is the perfect companion to ignite your imagination and enhance your creative process.

NGCBot

NGCBot is a WeChat bot based on the HOOK mechanism, supporting scheduled push of security news from FreeBuf, Xianzhi, Anquanke, and Qianxin Attack and Defense Community, KFC copywriting, filing query, phone number attribution query, WHOIS information query, constellation query, weather query, fishing calendar, Weibei threat intelligence query, beautiful videos, beautiful pictures, and help menu. It supports point functions, automatic pulling of people, ad detection, automatic mass sending, Ai replies, rich customization, and easy for beginners to use. The project is open-source and periodically maintained, with additional features such as Ai (Gpt, Xinghuo, Qianfan), keyword invitation to groups, automatic mass sending, and group welcome messages.

banana-slides

Banana-slides is a native AI-powered PPT generation application based on the nano banana pro model. It supports generating complete PPT presentations from ideas, outlines, and page descriptions. The app automatically extracts attachment charts, uploads any materials, and allows verbal modifications, aiming to truly 'Vibe PPT'. It lowers the threshold for creating PPTs, enabling everyone to quickly create visually appealing and professional presentations.

DocTranslator

DocTranslator is a document translation tool that supports various file formats, compatible with OpenAI format API, and offers batch operations and multi-threading support. Whether for individual users or enterprise teams, DocTranslator helps efficiently complete document translation tasks. It supports formats like txt, markdown, word, csv, excel, pdf (non-scanned), and ppt for AI translation. The tool is deployed using Docker for easy setup and usage.

NovelForge

NovelForge is an AI-assisted writing tool with the potential for creating long-form content of millions of words. It offers a solution that combines world-building, structured content generation, and consistency maintenance. The tool is built around four core concepts: modular 'cards', customizable 'dynamic output models', flexible 'context injection', and consistency assurance through a 'knowledge graph'. It provides a highly structured and configurable writing environment, inspired by the Snowflake Method, allowing users to create and organize their content in a tree-like structure. NovelForge is highly customizable and extensible, allowing users to tailor their writing workflow to their specific needs.

aitii-tekisuto

aitii-tekisuto is a unified technical documentation platform for AD domain control and data communication networks, covering architecture design, deployment, security hardening, and daily operation and maintenance. It helps you quickly build and maintain a stable and reliable enterprise network environment. The project uses MkDocs Material to provide a modern documentation site experience, integrating article content encryption functionality and smooth page transition animations for sensitive documents' security protection and optimized user browsing experience.

minimind-notes

MiniMind is a modular training guide for Large Language Models (LLMs), aiming to help developers deeply understand the training mechanism of modern large language models such as Llama and GPT through concise code and comparative experiments. It prioritizes principles over operations, provides experiments for each design choice, consists of 6 independent modules from basic components to complete architecture, and offers low entry barriers for learning. Suitable for individuals preparing for jobs in large model fields, students/researchers in machine learning/deep learning, developers, and learners with basic PyTorch knowledge who seek a deep understanding of LLMs. Not suitable for complete beginners, users only interested in deploying models quickly without caring about principles, and those looking for production-level code and best practices.

For similar tasks

obsidian-ollama-chat

Obsidian Ollama Chat is a plugin that enables users to interact with their local LLM (Large Language Model) to ask questions about their own notes. The plugin facilitates running a lightweight python server for indexing notes, allowing users to set a model URL, index files on startup and modification, and open a modal to ask questions. Future plans include text streaming for querying, a chat window for communication, and commands for quick queries like summarizing notes or topics.

second-brain-agent

The Second Brain AI Agent Project is a tool designed to empower personal knowledge management by automatically indexing markdown files and links, providing a smart search engine powered by OpenAI, integrating seamlessly with different note-taking methods, and enhancing productivity by accessing information efficiently. The system is built on LangChain framework and ChromaDB vector store, utilizing a pipeline to process markdown files and extract text and links for indexing. It employs a Retrieval-augmented generation (RAG) process to provide context for asking questions to the large language model. The tool is beneficial for professionals, students, researchers, and creatives looking to streamline workflows, improve study sessions, delve deep into research, and organize thoughts and ideas effortlessly.

laragenie

Laragenie is an AI chatbot designed to understand and assist developers with their codebases. It runs on the command line from a Laravel app, helping developers onboard to new projects, understand codebases, and provide daily support. Laragenie accelerates workflow and collaboration by indexing files and directories, allowing users to ask questions and receive AI-generated responses. It supports OpenAI and Pinecone for processing and indexing data, making it a versatile tool for any repo in any language.

xiaoyaosearch

XiaoyaoSearch is a cross-platform local desktop application designed for knowledge workers, content creators, and developers. It integrates AI models to support various input methods such as voice, text, and image to intelligently search local files. The application is free for non-commercial use, provides source code and development documentation, and ensures privacy by running locally without uploading data to the cloud. It features modern interface design using Electron, Vue 3, and TypeScript.

anything-llm

AnythingLLM is a full-stack application that enables you to turn any document, resource, or piece of content into context that any LLM can use as references during chatting. This application allows you to pick and choose which LLM or Vector Database you want to use as well as supporting multi-user management and permissions.

danswer

Danswer is an open-source Gen-AI Chat and Unified Search tool that connects to your company's docs, apps, and people. It provides a Chat interface and plugs into any LLM of your choice. Danswer can be deployed anywhere and for any scale - on a laptop, on-premise, or to cloud. Since you own the deployment, your user data and chats are fully in your own control. Danswer is MIT licensed and designed to be modular and easily extensible. The system also comes fully ready for production usage with user authentication, role management (admin/basic users), chat persistence, and a UI for configuring Personas (AI Assistants) and their Prompts. Danswer also serves as a Unified Search across all common workplace tools such as Slack, Google Drive, Confluence, etc. By combining LLMs and team specific knowledge, Danswer becomes a subject matter expert for the team. Imagine ChatGPT if it had access to your team's unique knowledge! It enables questions such as "A customer wants feature X, is this already supported?" or "Where's the pull request for feature Y?"

infinity

Infinity is an AI-native database designed for LLM applications, providing incredibly fast full-text and vector search capabilities. It supports a wide range of data types, including vectors, full-text, and structured data, and offers a fused search feature that combines multiple embeddings and full text. Infinity is easy to use, with an intuitive Python API and a single-binary architecture that simplifies deployment. It achieves high performance, with 0.1 milliseconds query latency on million-scale vector datasets and up to 15K QPS.

trieve

Trieve is an advanced relevance API for hybrid search, recommendations, and RAG. It offers a range of features including self-hosting, semantic dense vector search, typo tolerant full-text/neural search, sub-sentence highlighting, recommendations, convenient RAG API routes, the ability to bring your own models, hybrid search with cross-encoder re-ranking, recency biasing, tunable popularity-based ranking, filtering, duplicate detection, and grouping. Trieve is designed to be flexible and customizable, allowing users to tailor it to their specific needs. It is also easy to use, with a simple API and well-documented features.

For similar jobs

LLMStack

LLMStack is a no-code platform for building generative AI agents, workflows, and chatbots. It allows users to connect their own data, internal tools, and GPT-powered models without any coding experience. LLMStack can be deployed to the cloud or on-premise and can be accessed via HTTP API or triggered from Slack or Discord.

daily-poetry-image

Daily Chinese ancient poetry and AI-generated images powered by Bing DALL-E-3. GitHub Action triggers the process automatically. Poetry is provided by Today's Poem API. The website is built with Astro.

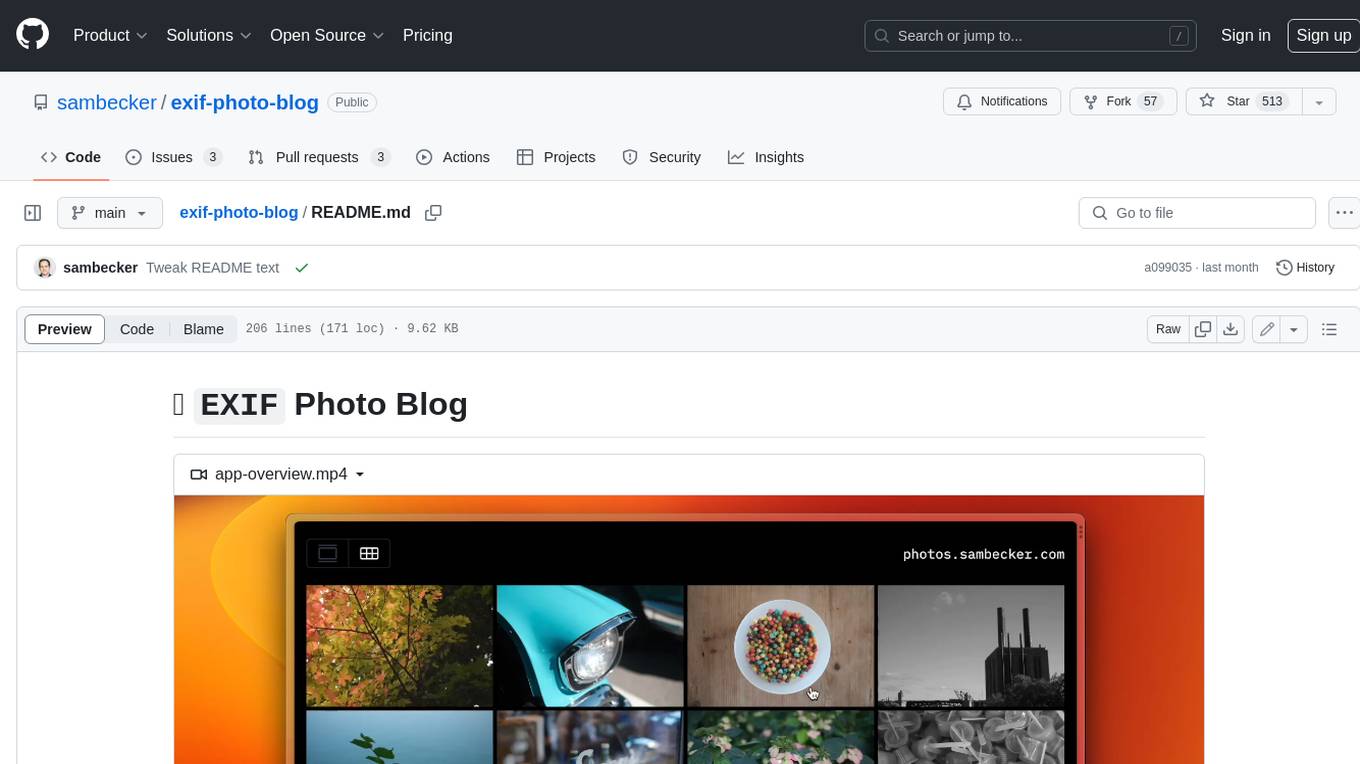

exif-photo-blog

EXIF Photo Blog is a full-stack photo blog application built with Next.js, Vercel, and Postgres. It features built-in authentication, photo upload with EXIF extraction, photo organization by tag, infinite scroll, light/dark mode, automatic OG image generation, a CMD-K menu with photo search, experimental support for AI-generated descriptions, and support for Fujifilm simulations. The application is easy to deploy to Vercel with just a few clicks and can be customized with a variety of environment variables.

SillyTavern

SillyTavern is a user interface you can install on your computer (and Android phones) that allows you to interact with text generation AIs and chat/roleplay with characters you or the community create. SillyTavern is a fork of TavernAI 1.2.8 which is under more active development and has added many major features. At this point, they can be thought of as completely independent programs.

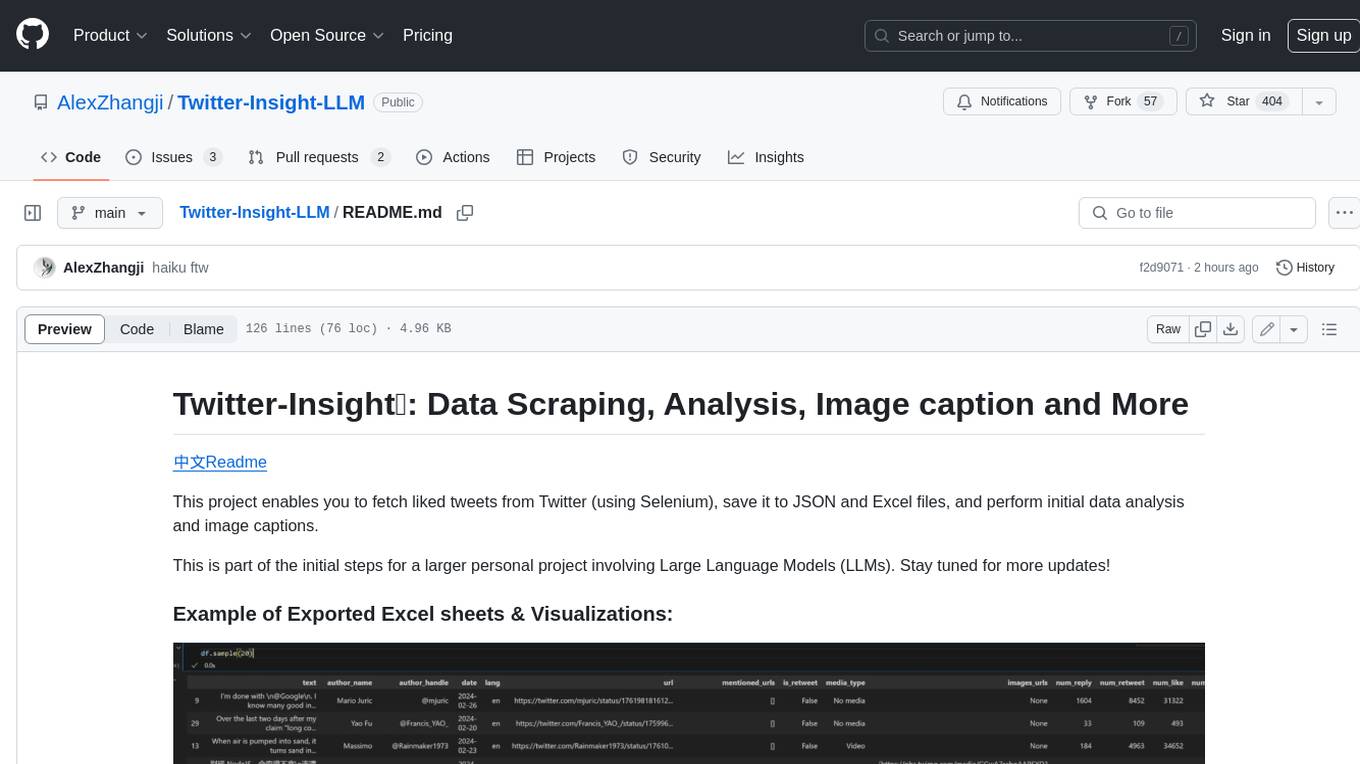

Twitter-Insight-LLM

This project enables you to fetch liked tweets from Twitter (using Selenium), save it to JSON and Excel files, and perform initial data analysis and image captions. This is part of the initial steps for a larger personal project involving Large Language Models (LLMs).

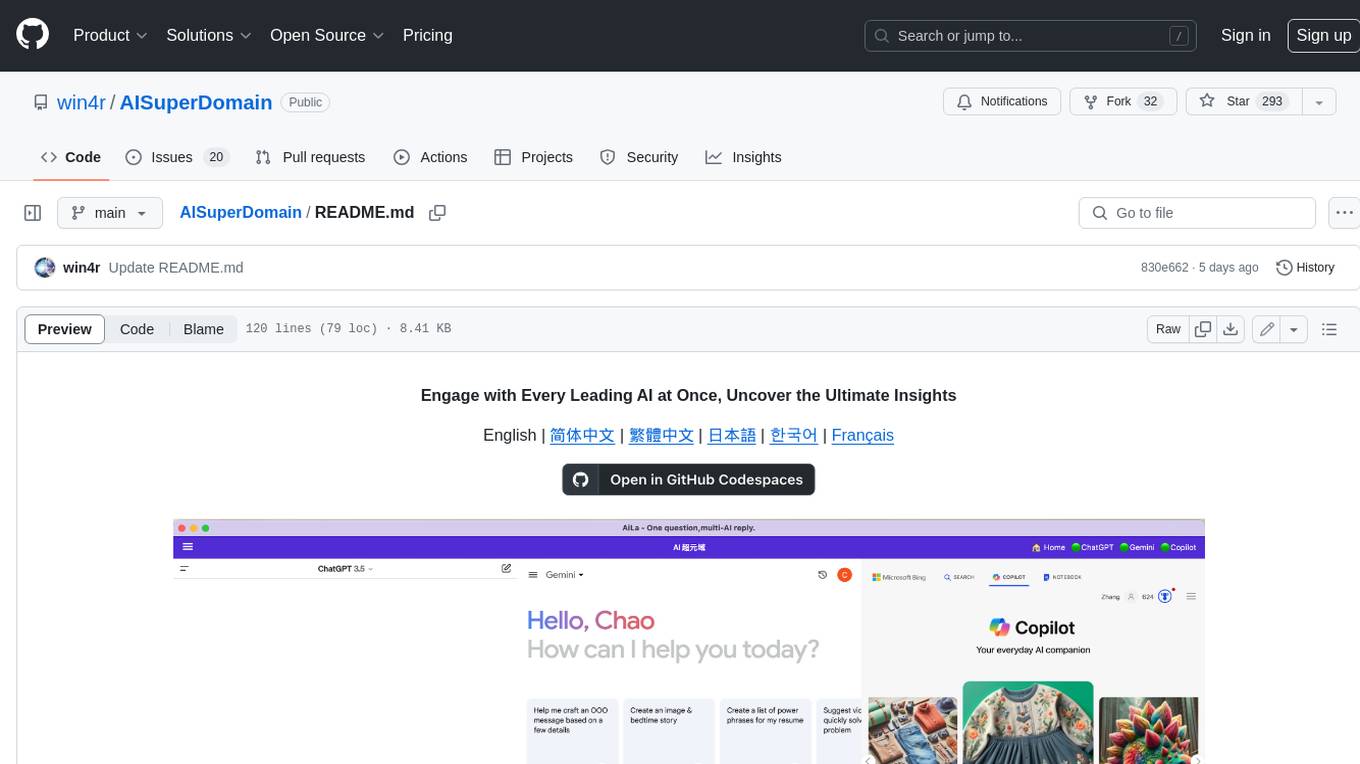

AISuperDomain

Aila Desktop Application is a powerful tool that integrates multiple leading AI models into a single desktop application. It allows users to interact with various AI models simultaneously, providing diverse responses and insights to their inquiries. With its user-friendly interface and customizable features, Aila empowers users to engage with AI seamlessly and efficiently. Whether you're a researcher, student, or professional, Aila can enhance your AI interactions and streamline your workflow.

ChatGPT-On-CS

This project is an intelligent dialogue customer service tool based on a large model, which supports access to platforms such as WeChat, Qianniu, Bilibili, Douyin Enterprise, Douyin, Doudian, Weibo chat, Xiaohongshu professional account operation, Xiaohongshu, Zhihu, etc. You can choose GPT3.5/GPT4.0/ Lazy Treasure Box (more platforms will be supported in the future), which can process text, voice and pictures, and access external resources such as operating systems and the Internet through plug-ins, and support enterprise AI applications customized based on their own knowledge base.

obs-localvocal

LocalVocal is a live-streaming AI assistant plugin for OBS that allows you to transcribe audio speech into text and perform various language processing functions on the text using AI / LLMs (Large Language Models). It's privacy-first, with all data staying on your machine, and requires no GPU, cloud costs, network, or downtime.